CBAM: Convolutional Block Attention Module

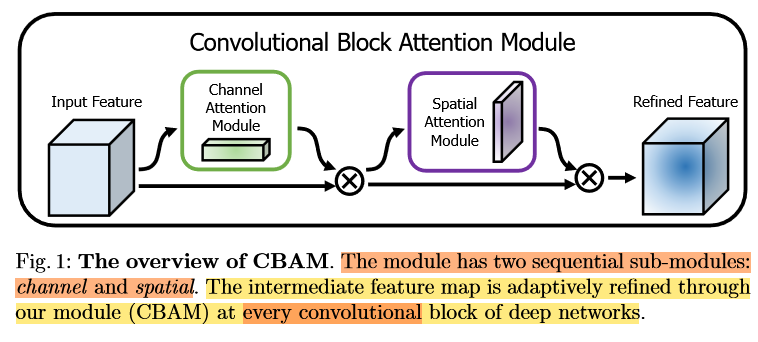

本文作者同时考虑空间注意力和通道注意力,提出了 CBAM 模块。每个注意力模块都通过 Average pooling 和 Max pooling 挖掘互补的特征 (Average pooling 提取全局统计特征,Max pooling 提取显著性特征)。该模块通过串联两种注意力机制,得到refined feature map(更好的对特征进行注意力增强)

本文作者同时考虑空间注意力和通道注意力,提出了 CBAM 模块。每个注意力模块都通过 Average pooling 和 Max pooling 挖掘互补的特征 (Average pooling 提取全局统计特征,Max pooling 提取显著性特征)。该模块通过串联两种注意力机制,得到refined feature map(更好的对特征进行注意力增强)

Links

- PDF Attachments: Woo 等。 - 2018 - CBAM Convolutional Block Attention Module.pdf

- Zotero Links: Local library

My Comments and Inspiration

- Attention not only tells where to focus, it also improves the representation of interests

- The channel attention focuses on “what” is important

- The spatial attention focuses on “where” is an important part.

Cores, Contributions and Conclusions

Preface

为了增强 CNN 的表达能力,目前非常多的工作关注三个重要的方面:depth,width 和 cardinality。而最近,一个新的方面 attention 也吸引了很多的关注。本文即关注在此。

作者希望能够通过注意力机制来使得网络关注(focus)在那些重要的特征上,并且抑制(supppress)一些无关的特征。考虑道卷积这个操作就是从空间和通道上对特征一起进行聚合的,所以本文也就从这两个方面着手进行注意力相关的工作。

Methods

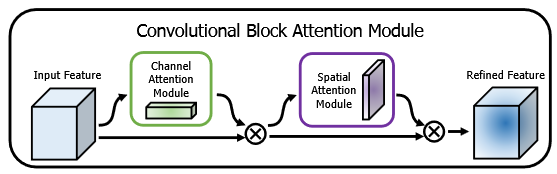

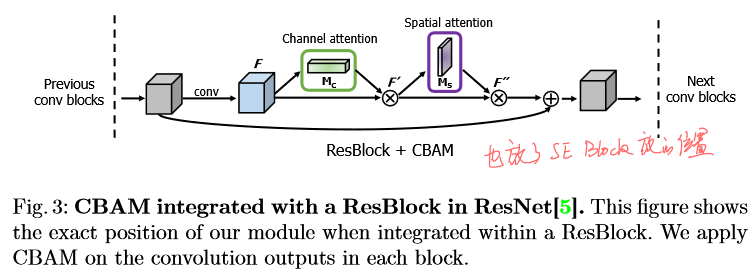

一句话总结:每个特征图依次通过通道注意力模块和空间注意力模块。

- 给定中间的特征图

- 经过 channel attention module 得到 attention refined feature map

- 经过 spatial attention module 得到 refined feature map , 即为CBAM的输出,是refined feature map

注意是直接以 为基础做的空间注意力增强,没有原始输入 什么事

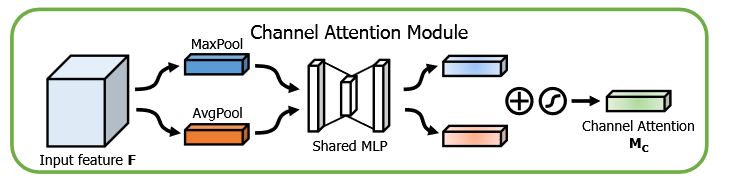

Channel attention module

- 对每个通道的特征图分别做 Max pooling 和 average pooling 得到两个 的向量

- 分别依次经过两个 FC (设置和 SENet 里对应部分一模一样),此时依然是两个 的向量

- 两个向量对应位置相加后经过 Sigmoid (先相加在过 Sigmoid)

- 做通道注意力增强 (同 SENet 对应部分)

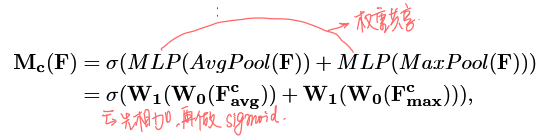

下为前三步的数学表示,第一个FC之后(即)后跟着ReLU,第二个后没有激活函数

为什么使用两个 pooling?

- Max pooling 能够在某种程度上挖掘特征中的显著性特征,而 average pooling encode global statistics softly,两个能够互补(作者原话)

We argue that max-pooled features which encode the degree of the most salient part can compensate the average-pooled features which encode global statistics softly.

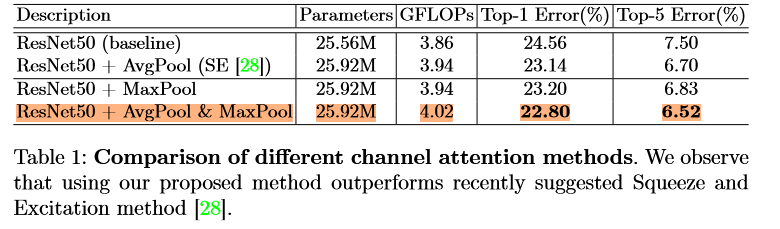

- 消融实验证明两个一起用就是比单独用这两个结果好

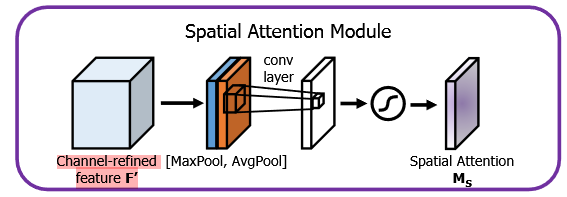

Spatial attention module

- 沿着通道维度分别做 Max pooling 和 average pooling,得到两个 的特征图,将它们拼接起来得到

- 经过 的卷积,保持尺寸不变,通道数变为 1

- 经过 Sigmoid 得到 spatial attention map

- 做空间注意力增强

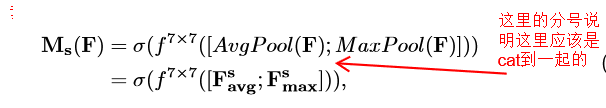

前3步的数学化表示

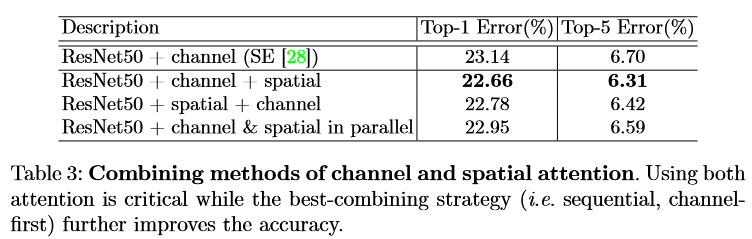

为什么使用串联而非并联?

- 实验证明串联结果更好

- 实验证明串联的前提下通道在前空间在后结果更好

插入到现有网络中

跟SENet插入的位置一样,但是本文没有进一步探究插入位置对结果的影响

Experiments

Channel attention 中,使用两个 pooling 效果比仅使用其中任何一个结果都好

Saptial attention 中得到 的操作,avg&map+大的卷积核效果好 (),作者认为对于空间注意力,需要使用大尺寸的卷积核进行感知

作者实验了两大类,一类是直接卷积+卷积做,但是是 ,另一类是基于两种 pooing+卷积的,并且最后一个卷积设置了不同的卷积核尺寸

“It implies that a broad view (i.e. large receptive field) is needed for deciding spatially important regions” (Woo 等。, 2018, p. 9)

channel 和 spatial attenon 的顺序和架构实验,表明 c+s 串联结构最好

除此之外,作者还进行了Grad-CAM的注意力关注可视化实验;也将注意力图给人们去看,让人们去挑说哪个网络关注重点关注的更准;在IamgeNet-1K上的图像分类,MS COCO Object Detection,VOC 2007 Object Detection的实验

Some Descriptions

“We further push the performance by exploiting the spatial attention.”